目次

AI技術の進化により、記事の初稿作成時間は劇的に短縮されました。しかし、その一方で「ハルシネーション(もっともらしい嘘)」への対策として、人間による膨大なファクトチェック工数が発生するという新たな課題が浮き彫りになっています。

本記事では、AI記事作成における情報の正確性を担保しながら、制作プロセス全体を効率化する具体的な手法を解説します。検証コストの削減とメディアの信頼性維持を両立させるための、テクノロジーと人間の役割分担、そして戦略的なフロー構築について深く掘り下げていきましょう。

なぜAI記事作成においてファクトチェックによる信頼性担保が急務なのか

AIによる自動執筆が普及する中で、なぜ今「信頼性の担保」が求められているのでしょうか。ここでは、従来の手法が抱える限界と、情報の不備がもたらすビジネス上のリスクについて整理します。

単なるミス防止の観点だけでなく、メディアの資産価値を守り、持続可能な運営体制を築くための背景を解説します。効率化の第一歩は、現状の課題を正しく構造化して理解することから始まります。

制作スピードのボトルネックとなる「人力検証」の限界

AIライティングツールを導入する最大の目的は、記事制作の高速化や担当者の負担軽減にあるはずです。しかし、現実にはAIが生成した初稿に対し、人間が一つひとつの事実関係を裏取りする「人力検証」が、全体の工程を圧迫する最大のボトルネックとなっています。

AIは確率的に「もっともらしい言葉」を繋ぎ合わせる特性を持つため、文脈は自然であっても、その内容が真実である保証はありません。結果として、編集者はAIが生成した一文ごとに「これは本当か?」と疑い、検索エンジンや公認の統計資料をひっくり返して確認作業に追われることになります。

これでは、AIによる執筆時間の短縮分が、そのまま検証時間の増大によって相殺されてしまいかねません。特に、専門性の高い分野や最新情報が求められるトピックでは、人間がゼロから執筆するよりも、AIの誤りを修正する方が多くのエネルギーを消費するという皮肉な事態も発生しています。

効率化の仕組みがないままAIを導入することは、現場に新たな作業負担を強いることと同義なのです。

誤情報の掲載がブランド価値とSEOに与える致命的なダメージ

インターネット上に公開される情報は、メディアの信頼性そのものです。もしAIが生成したハルシネーション(もっともらしい嘘)を見逃し、そのまま掲載してしまった場合、その代償は計り知れません。一度失った読者からの信頼を取り戻すには、多大な時間と努力を要します。また、誤った情報によって読者が不利益を被るリスクも無視できません。

検索エンジン最適化(SEO)の観点からも、情報の正確性は極めて重要です。主要な検索エンジンは、コンテンツの評価基準として「E-E-A-T(経験、専門性、権威性、信頼性)」を重視しています。事実と異なる内容が含まれる記事は、信頼性の低い低品質なコンテンツと見なされ、検索順位の著しい下落を招く恐れがあります。

さらに、サイト全体の評価が下がれば、他の健全な記事の順位まで引きずり込まれるリスクも孕んでいます。AIのスピードを優先するあまり、メディアが長年築き上げてきた資産価値を一日で毀損させてしまうような事態は、何としても避けなければなりません。

編集者の心理的負荷とリソース配分の不均衡

効率化が進まないファクトチェック体制は、現場の編集者やライターに深刻な心理的負荷を与えます。「自分の見落としがメディアの致命傷になるかもしれない」というプレッシャーの中で、膨大なAI生成文と向き合い続けるのは、精神的な消耗が激しい作業です。

本来、編集者が注力すべき「企画の立案」や「独自の切り口の追加」といったクリエイティブな業務に割くべきリソースが、事実確認という単純かつ過酷な作業に奪われてしまいます。

このようなリソース配分の不均衡が続くと、現場のモチベーションは低下し、結果としてコンテンツの質そのものが低下する悪循環に陥ります。

人間がAIに使役されるような体制ではなく、人間が本来の強みを発揮できる環境を整えることが、組織的なメディア運営において不可欠です。AIの執筆能力を最大限に活かしつつ、編集者が確信を持ってコンテンツを世に送り出せるような、スマートな検証フローの構築が今まさに求められています。

AIが生成する情報の特性と「嘘」を見抜くための基本原則

AIは膨大なデータから確率的に文章を生成するため、事実に基づかない「ハルシネーション(幻覚)」を引き起こす性質があります。

効率的なチェックを行うためには、まずAIがどのような仕組みで誤情報を生み出すのか、その「癖」を正しく把握することが不可欠です。情報の真偽を機械的に疑うマインドセットを持ち、重点的に確認すべきポイントを絞り込むことで、検証作業の精度とスピードは飛躍的に向上します。

ここでは、AI特有の情報の特性と、嘘を見抜くための基本的な考え方を整理します。

学習データの鮮度と「もっともらしい嘘」が生まれる背景

AIが生成する文章が驚くほど自然である理由は、次に来る確率が高い言葉を予測して繋ぎ合わせる「言語モデル」の仕組みにあります。

しかし、この仕組みは「事実であること」を保証するものではありません。AIは文脈の整合性を優先するため、知らない情報であっても過去の学習データから推測し、あたかも事実であるかのように滑らかな文章を作成してしまいます。

また、AIの学習データには必ず「カットオフ(学習終了時期)」が存在します。それ以降に発生した最新のニュースや法改正、統計データの変動などについては、AIは正確な知識を持っていません。最新情報が必要な場面で古い情報を基に出力したり、足りない情報を想像で補完したりすることが、いわゆる「もっともらしい嘘」が発生する主な要因です。

制作者側がこのメカニズムを理解していれば、「AIは常に最新かつ正確な事実を述べているわけではない」という前提に立ち、過度な信頼を避けることができます。執筆の効率化を図る際も、この構造的な弱点を意識した上で、AIが得意な「構成案の作成」と、苦手な「事実の提示」を明確に区別する姿勢が求められます。

数値、固有名詞、日付:AIが最も間違いやすい情報の傾向

AIが生成する記事の中で、特にハルシネーションが発生しやすい項目には明確な傾向があります。その代表例が、次に挙げるような項目です。

- 数値データ

- 固有名詞

- 具体的な日付

- 具体的なURL

これらの情報は文章全体の流れの中では一部分に過ぎませんが、一つの誤りが記事全体の信頼性を失墜させる致命的な要因となります。

例えば、統計調査の結果として示される基準値や、特定の法律の条文番号などは、AIが似たような文脈から誤った数字を引用したり、複数のデータを混ぜ合わせたりするリスクが高い部分です。

固有名詞についても、実在する組織名と架空の名称を混同したり、サービスの内容を誤解して出力したりすることが珍しくありません。URLに至っては、構造だけを模倣した「存在しないリンク」を生成することも多々あります。

効率的なファクトチェックを実現するためには、文章全体を漫然と読み直すのではなく、こうした「間違いやすいポイント」をスキャンするように重点検閲する手法が有効です。重要な数値や名称が一つでも含まれている場合は、その箇所だけは必ず外部の信頼できるデータベースや公式サイトと照合するというルールを徹底することで、最小限の工数で高い正確性を維持できます。

なお、これらの事実確認作業はAIが登場する以前は、熟練の校正者や校閲者が担当していた領域です。執筆した原稿が人間によるものかAIによるものかが違うだけで、チャックの観点は従来から大きく変わるものではありません。

一次ソースへの到達を前提とした「検証可能性」の確保

AIによる執筆を効率化する上で欠かせないのが、すべての記述に対して「検証可能性」を確保するという原則です。検証可能性とは、その情報の根拠がどこにあるのかを、第三者が容易に辿れる状態を指します。AIが生成した情報がどんなに正しく見えても、出典が不明なまま掲載することは、メディア運営における最大のリスクとなります。

ファクトチェックの工数を削減するためには、AIに執筆をさせる段階から、可能な限り一次ソース(官公庁の発表資料や学術論文、公式サイトのプレスリリースなど)を参照させるプロンプトを組むことが重要です。

また、生成された文章の根拠となった情報源をAI自身に提示させ、そのソースが実在し、かつ信頼に足るものであるかを人間が確認するフローを構築します。

もしAIが根拠を示せない情報や、出典が曖昧な情報を出力した場合は、その箇所を「未検証」として扱い、削除または再リサーチの対象とします。情報の正誤を一つひとつ調べるのではなく、「信頼できる一次ソースに裏付けられているか」という一点に集中して確認を行うことで、編集者の判断スピードは劇的に向上します。

信頼性の高いソースへの到達を習慣化することが、結果として最も効率的な検証ルートとなるのです。

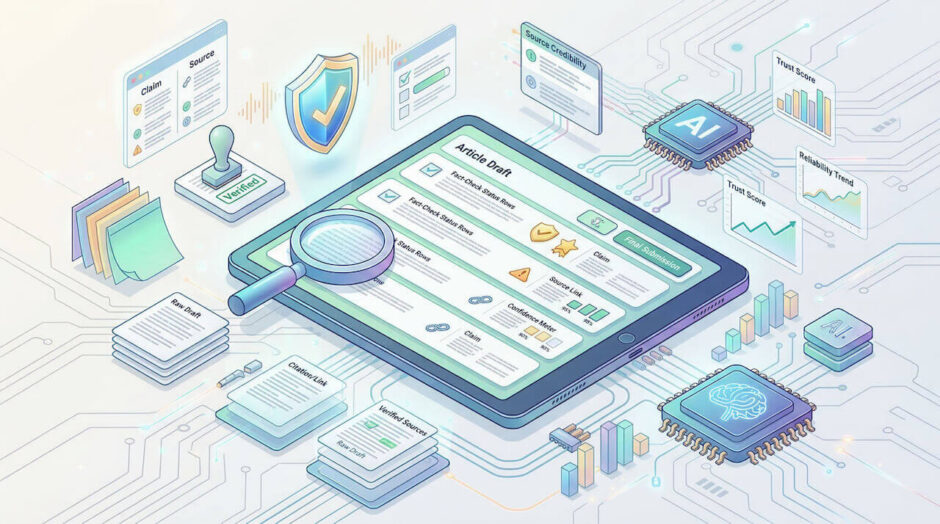

効率的なファクトチェック体制を構築する5つのステップ

AIによる記事作成を効率化するためには、行き当たりばったりの確認ではなく、仕組み化された検証フローが不可欠です。属人的な作業を標準化されたプロセスへと変換することで、ヒューマンエラーを防ぎつつ、編集リソースを最適に配分できるようになります。

ここでは、組織として持続可能なファクトチェック体制を構築するための5つの具体的なステップを詳しく解説します。

ステップ1:情報の重要度に応じた検証基準の策定

すべての情報に対して一律の熱量でファクトチェックを行うのは、リソースの観点から現実的ではありません。まずは、情報の性質や誤報時のリスクに基づき、検証の強度を分ける基準を策定します。

例えば、数値データや固有名詞、法律に関わる記述などは「最優先確認事項」とし、公的な一次ソースとの照合を必須とします。一方で、一般的な概念の説明や筆者の主観に基づく表現については、論理的な整合性の確認に留めるといった切り分けが有効です。

このように「どこまで厳密に調べるか」のデッドラインを明確に定義することで、編集者の迷いを排除し、確認作業のスピードを劇的に向上させることが可能になります。

ステップ2:AIによる自己検閲プロンプトの導入

人間が確認する前の段階で、AI自身に生成内容の不備をチェックさせる工程を組み込みます。記事を生成した後に「上記の内容に事実誤認や、根拠が不明確な記述がないか検証し、疑わしい箇所をリストアップしてください」といった自己検閲用のプロンプトを実行する手法です。

AIは自身の出力に対して客観的な視点を与えることで、ハルシネーション(もっともらしい嘘)を自ら発見できる場合があります。

このステップを挟むことで、明らかな誤情報を事前に排除でき、人間が向き合うべき課題を「高度な判断が必要な箇所」だけに絞り込むことができます。前工程でのフィルタリングが、後工程の負担を最小化する鍵となります。

ステップ3:自動照合ツールの活用による初期スクリーニング

テクノロジーを駆使して、事実関係の照合を半自動化します。現在のAI技術や外部ツールを活用すれば、生成された記述がインターネット上の信頼できる情報源と合致しているかを、高速にスクリーニングすることが可能です。

具体的には、AIにブラウジング機能を与えて最新の公式情報を検索させ、出力内容との乖離がないかを確認させるフローが挙げられます。

また、特定の専門領域であれば、信頼性の高いデータベースとAPI連携を行い、機械的に情報の正誤を判定する仕組みの導入も検討に値します。こうした初期スクリーニングにより、単純な事実誤認の多くを自動で検知できるようになります。

ステップ4:人間による「文脈と妥当性」の最終審議

自動化によるスクリーニングを経た後は、編集者による最終的な判断を行います。AIが得意とするのは「事実の照合」ですが、情報の「文脈(コンテキスト)」や「読者にとっての妥当性」を評価するのは、依然として人間の役割です。

提示された事実が記事のテーマに沿って正しく解釈されているか、あるいは最新の社会情勢に照らして不適切な表現が含まれていないかを確認します。AIが「正しい」と判断したデータであっても、それが読者のニーズやメディアのトーンに合致しているかという視点で磨き上げることで、記事の品質と信頼性は完成へと近づきます。

ステップ5:フィードバックループによるAI生成精度の向上

ファクトチェックの結果を、単なる修正で終わらせてはいけません。発見された誤情報の傾向を分析し、AIへの指示(プロンプト)や参照データへとフィードバックする仕組みを構築します。

「この種の数値データは間違いやすい」といった傾向が掴めれば、執筆時のプロンプトに「統計データは必ず官公庁の最新資料を参照すること」といった制約を加えることで、次回の生成精度を高められます。

この改善サイクルを回し続けることで、時間の経過とともに検証コストは下がり、メディア全体の生産性は向上していきます。組織的な知見として蓄積することが、AI時代の編集チームには求められます。

「川上」で防ぐ:執筆前のリサーチ工程における効率化戦略

記事が出来上がってから誤りを見つけ、修正を繰り返すのは非常に非効率です。それよりも、執筆を開始する前の段階で、AIが参照すべき「正しい情報」を適切に与える仕組みを整えるほうが、最終的な工数は劇的に削減されます。いわゆる「後工程」の負担を減らすための「前工程」の最適化こそが、AI時代の編集フローにおける鍵となります。

ここでは、リサーチ段階にAIを戦略的に介入させ、ファクトチェックの必要性そのものを最小化するアプローチについて詳しく見ていきましょう。

信頼性の高いソースのみを学習・参照させる「RAG」の概念

RAG(検索拡張生成)という技術概念は、AI記事作成の信頼性を根本から変える可能性を秘めています。これは、AIが持つ内部知識だけに頼るのではなく、外部にある特定の信頼できる情報源を検索し、その内容に基づいて回答を生成する仕組みです。

通常、AIは学習データの確率統計に基づいて文章を作りますが、これでは最新情報や専門的な事実において誤り(ハルシネーション)が生じやすくなります。しかし、あらかじめ指定した公式ドキュメントや信頼性の高いデータベースを優先的に参照させることで、情報の正確性は飛躍的に向上します。

この手法を導入すると、AIは「自分の知っていること」ではなく「提供された資料にあること」をベースに執筆するため、人間による事後の事実確認が大幅に簡略化されます。特定の業界ルールや社内ガイドラインを遵守させたい場合にも非常に有効な戦略です。

正確な構成案を作成するためのリサーチ自動化手法

高品質な記事を短時間で仕上げるには、執筆前の構成案作成におけるリサーチの精度が重要です。AIを単に「文章を書く道具」として使うのではなく、「調査を支援するパートナー」として活用することで、後段のファクトチェック工数を削減できます。

具体的には、ターゲットキーワードに関連する最新の動向や公的な統計データをAIに収集させ、それらを整理した上で構成案を作成するフローが効果的です。この段階で事実関係の骨子を固めておけば、執筆プロセスで嘘が紛れ込むリスクを物理的に抑えられます。

また、リサーチの自動化ツールを活用し、複数の検索結果を要約させたり、共通して言及されている重要トピックを抽出させたりすることも有効です。人間がゼロから検索を繰り返す手間を省きつつ、情報の網羅性と正確性を担保した「間違いの少ない設計図」を完成させることが、効率化への近道となります。

根拠(エビデンス)を同時出力させるプロンプトエンジニアリング

執筆時のプロンプト(指示文)に一工夫加えるだけで、検証作業の負担はさらに軽くなります。単に「記事を書いて」と命じるのではなく、主張の根拠となるエビデンスを同時に出力させるように指示を出すことがポイントです。

例えば、「各セクションの主張を裏付ける公的なソースや統計データを提示し、可能な限りその参照元URLを記載してください」といった条件を付け加えます。こうすることで、編集者はAIが生成した記述がどの情報に基づいているのかを即座に確認できるようになります。

ただし、AIが架空のURLを生成する場合もあるため、過信は禁物です。それでも、AIに「根拠を探しながら書く」というプロセスを課すことで、根拠のない断定的な表現や適当な数値の羅列を防ぐ抑止力として機能します。情報を「出力させる」ことと「その出所を明示させる」ことをセットにすることを、運用の標準ルールとして組み込みましょう。

テクノロジーを味方につける:検証工程を半自動化するアプローチ

AIの進化は目覚ましいものですが、そのアウトプットの最終責任を持つのは依然として人間です。しかし、すべての確認作業を人力で行っていては、AI導入のメリットである「スピード」が相殺されてしまいます。

機械が得意な「機械的な照合」と、人間が得意な「文脈の判断」を明確に切り分けることが、品質維持と効率化を両立させる鍵となります。ツールを賢く使いこなし、編集チームのパフォーマンスを最大化させるための具体的な手法を見ていきましょう。

リンク切れチェックと出典元の自動検証機能

AIが生成した文章に含まれるURLや出典情報の正確性を確認する作業は、非常に手間がかかります。特にAIは、実在しないURLをさも存在するかのように生成する「ハルシネーション」を起こすことがあるため、URLの生存確認は欠かせない工程です。

このプロセスを効率化するには、リンク切れチェック専用のブラウザ拡張機能や、一括でステータスを確認できる校閲支援スクリプトの活用が有効です。これにより、目視で一つひとつクリックしてページを開く必要がなくなり、アクセス不可なリンクを瞬時に特定できます。

また、最新のAIツールの中には、生成した情報の根拠となったソースをリアルタイムで検索し、提示する機能を持つものもあります。こうした機能を活用することで、出典元のサイトが信頼できる公的機関や大手メディアであるかを、記事の構成段階で即座に判断できるようになります。情報の「出どころ」を自動でリストアップする仕組みを整えることが、検証コストの大幅な削減につながるのです。

表記揺れと事実の不整合を検出する自然言語処理の応用

記事全体の整合性を保つためには、表記の統一だけでなく、文中での事実関係の矛盾を排除しなければなりません。例えば、記事の冒頭では「2023年」と記載されているデータが、後半では「2022年」となっているような、AI特有の微細な不整合を人間が見抜くには高度な集中力が必要です。

こうした課題には、自然言語処理(NLP)を用いた校閲支援ツールが威力を発揮します。特定のキーワードや数値に注目し、文脈の中での一貫性を自動的にスキャンすることで、人間が見落としがちなミスをアラートとして表示させることが可能です。

さらに、社内の編集ガイドラインを読み込ませたカスタム校閲エンジンを導入すれば、独自の禁止用語や推奨表現との照合も自動化できます。機械的なチェックをツールに任せることで、編集者は「読み手にとって価値のある内容か」「論理構成は適切か」といった、より高次元の推敲にリソースを集中できるようになります。

AIに「自身の主張の根拠」を再質問させるダブルチェック法

AIの出力を、別のAI(あるいは同一AIの別セッション)に検証させる「セルフチェック・プロンプト」の活用も非常に効果的です。記事を生成した直後に、「今書いた内容に事実誤認はないか」「各主張の具体的な根拠となる一次ソースを提示せよ」と追加で指示を出します。

この手法のポイントは、AIに自身の回答を客観的に見直させるステップを設けることです。AIは一度の出力では誤りに気づかなくても、特定の箇所を絞り込んで質問されることで、誤情報を自己修正する傾向があります。

特に、数値データや固有名詞が含まれる段落については、「この数値の算出根拠は何か」「最新の統計に基づいているか」と繰り返し確認を行うフローを組み込みましょう。AIによる「1次回答」と「検証回答」を比較することで、人間が重点的に確認すべき箇所が明確になります。プロンプトを工夫し、AIに自律的な校閲機能を持たせることが、全体の工数削減に大きく寄与します。

記事ジャンル別:検証の優先順位と判断基準の最適化

すべての記事に一律の厳格なファクトチェックを適用するのは、リソースの観点から見て効率的ではありません。情報の性質や読者に与える影響度によって、許容されるリスクと検証に注力すべきポイントは大きく異なります。

ジャンルごとの特性に合わせた「メリハリのある検証」を行うための判断基準を明確にし、優先順位を定義することで、限られた編集リソースを最適に配分することが可能になります。

ここでは、主要なジャンル別のチェック指針について解説します。

YMYL(健康・金融など)領域における最高レベルの検証基準

AI記事作成において、最も厳格なファクトチェックが求められるのがYMYL(Your Money or Your Life)領域です。健康、医療、金融、法律といった分野の情報は、読者の人生や身体、財産に重大な影響を及ぼすため、誤情報の掲載はメディアの信頼失墜だけでなく、法的なリスクも伴います。

医療系コンテンツであれば、薬機法や医療広告ガイドラインの遵守が不可欠です。AIが生成した「効能効果」や「治療法」が最新の医学的根拠に基づいているか、厚生労働省や国立病院などの公的機関が発信する一次情報と照らし合わせる作業は省略できません。金融系においても、金融商品取引法に基づき、誇大広告や断定的判断の提供を避ける必要があります。

これらの領域における効率化のポイントは、AIによる初期スクリーニングと、専門家による「人間による監修」を組み合わせることです。AIに公的データの引用チェックを指示し、その出力結果が正しい出典に基づいているかを人間が最終確認する二段構えの体制を構築しましょう。

検証コストは高くなりますが、正確性を最優先することが、結果としてメディアの資産価値を守る最短ルートとなります。

トレンド情報・ニュース記事におけるスピードと正確性の両立

最新のトレンドやニュースを扱う記事では、正確性に加えて「鮮度」が重要な価値を持ちます。

しかし、AIは学習データのカットオフ(学習終了時点)の関係上、最新の出来事についてハルシネーション(もっともらしい嘘)を起こしやすいという特性があります。そのため、このジャンルでは「公開スピード」と「裏付け作業」のバランスをどう最適化するかが鍵となります。

効率的な検証を行うためには、公式発表(プレスリリース)や官公庁の速報、信頼できる大手通信社の報道といった「一次情報」へのアクセスを最短化するフローを構築しましょう。AIに執筆を依頼する際、あらかじめ最新のニュースソースのテキストやURLをリファレンスとして与えることで、AIが情報を捏造するリスクを大幅に低減できます。

また、イベントの日時、場所、人名の漢字、役職名といった固有名詞は、AIが最も間違いやすい箇所です。これらは自動照合ツールやブラウジング機能を活用して、公式サイトの記載と一致するかを機械的に判別させることで、目視による確認工数を削減できます。

正確な一次情報が確認できない不確かな情報については、あえて掲載を見送る、あるいは「〜と報じられている」といった伝聞形式であることを明確にするなど、表現の段階でリスクヘッジを行うことも効率化の一環です。

コラム・体験談における「主観」と「事実」の切り分け

コラムやエッセイ、体験談などの記事では、執筆者の「主観」や「感想」がコンテンツの核となります。しかし、その背景にある「客観的事実」に誤りがあると、記事全体の説得力が根底から損なわれます。ここでは「感性に基づく主観」と「検証が必要な客観的事実」を明確に切り分けることが効率化の第一歩です。

例えば、「この温泉は最高にリラックスできた」という感想は主観であり、厳密な検証の必要はありません。しかし、「この温泉の泉質はアルカリ性である」という記述は、施設の公式サイト等で確認すべき客観的事実です。AIはこうした主観的な文脈の中に、存在しない歴史的エピソードや架空の周辺施設情報を、あたかも真実であるかのように織り交ぜることがあります。

効率的なチェックのためには、まずAIが生成した文章の中から、数値、地名、歴史的事実、統計データなど、客観的に正誤が判定できる箇所を抽出します。その上で、重要な事実のみをピックアップして検証を行う「スポットチェック」を導入しましょう。すべての文章を同じ熱量で精読するのではなく、情報の重要度に応じて検証の深度を変えることで、コラム特有の情緒的な魅力を損なわずに、信頼性の高いコンテンツを量産することが可能になります。

【FAQ】AI記事作成とファクトチェックに関するよくある疑問

AI記事作成の現場では、理論通りに進まない細かな疑問や予期せぬトラブルが頻繁に発生します。ハルシネーション(もっともらしい嘘)への具体的な対処法から、外部パートナーとの連携、コストと品質のバランスに至るまで、実務担当者が直面しやすい悩みを整理しました。

これらの回答をチーム内で共有することで、迷いのない効率的な運用体制を築くヒントが得られるはずです。組織への導入を円滑に進めるための判断材料として活用してください。

- AIが生成した出典URLがリンク切れ・架空なのはなぜ?

- AIは「次に続く確率が高い文字」を予測して文章を生成する仕組みを持っているため、実在するドメイン名とそれらしいディレクトリ構造を勝手に組み合わせて、存在しないURLを作り出してしまうことがあります。

これはハルシネーション(幻覚)の典型的な例であり、特に最新のニュースやニッチな分野の出典を求める際に発生しやすくなります。

対策としては、AIにURLを直接出力させるのではなく、特定の信頼できるドメイン内(官公庁のサイトなど)から検索させる設定や、検索エンジンと連携したブラウジング機能を活用することが有効です。

また、出力されたURLは必ずクリックして生存確認を行うか、リンクチェックツールを用いて一括検証する工程を標準化しましょう。根拠となる情報のタイトルをAIに出力させ、そのタイトルで検索して正しいURLを人間が紐付けるといった、検索工程の分離も確実性を高める手法の一つです。

- 検証コストを下げすぎて品質が低下するのが怖い場合は?

- すべての情報を一律に疑うのではなく、情報の性質に応じて「検証の深度」に傾斜をつけることが、効率化と品質維持を両立させるポイントです。

例えば、読者の不利益に直結する可能性のある法律や健康、金融に関する具体的な数値データは一次ソースまで遡って厳格に確認します。一方で、一般的な概念の解説や、周知の事実を言い換えただけの文章などは、AIによる自己検閲プロンプトでの確認に留めるといった基準を設けます。

運用開始時は「過剰」と思えるほど詳細なチェックリストを作成し、一定期間の運用を経て「ミスの発生頻度が低い項目」を特定しましょう。そのデータに基づき、段階的に簡略化できるポイントを探るのが安全な進め方です。

品質の閾値を明確に言語化し、編集チーム全体で「どのラインまではAIに任せ、どこからは人間が踏み込むべきか」を合意形成しておくことが、心理的な不安の解消にもつながります。

- 外部ライターにAI使用を許可する際のチェック体制は?

- 外部ライターがAIを使用する場合、最終的な成果物の責任は発注側(メディア運営側)にあるという前提で管理体制を整える必要があります。

具体的な運用面では、AI使用の有無を申告させる「使用報告義務」を設けるとともに、提出時に「どの箇所をどのソースでファクトチェックしたか」の根拠資料(参考にした一次情報のURLリストなど)を併せて提出させるフローを導入しましょう。

ライター側に検証のプロセスを可視化させることで、安易なコピペを防ぎ、編集側の確認工数を大幅に削減できます。また、AI特有の不自然な言い回しや情報の誤りがないかを確認するための「検収ガイドライン」を事前に共有し、品質基準の認識のズレを最小限に抑えることが不可欠です。

- ファクトチェックの自動化ツールは自社開発すべき?

- 自社のコンテンツ量や予算、求められる検証の厳密さによって判断は分かれます。

月間の制作本数が数百本から数千本に及ぶ大規模メディアであれば、特定の信頼できるデータベースと照合するAPIを活用した社内ツールの開発は、長期的なコスト削減において大きなメリットがあります。開発によって、自社が重視する特定の表記ルールや事実確認の工程を、完全にワークフローへ組み込むことが可能になるからです。

一方で、中規模以下のメディア運営であれば、既存のAI校閲支援ツールや、検索エンジンと連携したブラウザ拡張機能を活用するだけでも十分に効率化は可能です。

まずは汎用ツールの組み合わせで「どの工程を自動化できるか」を洗い出し、それでも解消できない自社特有の課題や、人間が介在することによる致命的な遅延がある場合にのみ、独自開発を検討することをお勧めします。

信頼を資産に変える:AI時代のメディア運営を成功へ導くロードマップ

AI技術の進化に伴い、コンテンツ制作のスピードは飛躍的に向上しました。しかし、メディアの根幹を支えるのは、いつの時代も情報の「正確性」と「信頼性」です。

効率的なファクトチェック体制の構築は、単なるリスク回避の手段ではなく、競合との差別化を図るための強力な戦略となります。テクノロジーと人間が共生し、信頼を資産へと変えていくための持続可能なメディア運営の在り方を考え、明日からの具体的なアクションに繋げていきましょう。

AIを使いこなしつつ、読者に届ける情報の質を維持する仕組みこそが、次世代のメディア運営の鍵です。検証プロセスの自動化と人的リソースの最適配置を並行し、信頼される媒体としての価値を高めていきましょう。まずは現在の制作フローを棚卸しし、一歩ずつ精度の高い体制へとアップデートすることをお勧めします。